Introducir a la econometría requiere estudiar de forma minuciosa cada uno de los elementos que permiten el análisis de regresión y si bien podemos calcular cada uno de estos usando las fórmulas que provee la teoría, la idea de usar programas de paquetes estadísticos como R es usar instrucciones que nos permitan hacer este tipo de cálculos de forma automática.

También pudiera interesarte

La instrucción lm()

Si se cuentan con al menos dos variables, digamos y

, podemos determinar la Recta de Regresión Muestral usando la instrucción lm() usando la virgulilla ~ para definir la relación entre las dos variables. La sintaxis para definir un modelo lineal que describa a la variable dependiente

en función de la variable independiente

es la siguiente:

lm(Y ~ x)Al ejecutar esta instrucción se mostrará el valor de que es el punto de corte con el Eje de la variable

y el valor de

que es el parámetro que multiplica a la variable

(también conocido como el peso de la variable).

Esta información puede almacenarse en una variable pues a partir de ella obtener información valiosa sobre nuestro modelo. Entonces, para almacenar esta información en una variable, digamos yx.lm, usamos la siguiente sintaxis:

yx.lm <- lm(Y ~ x)Veamos la información básica que podemos obtener definiendo del modelo lineal de esta forma.

coefficients

Podemos observar directamente los coeficientes del modelo lineal haciendo el llamado coefficients a partir de la variable que almacena la información del modelo lineal, para esto, recurrimos el símbolo de dólar $ usando la siguiente sintaxis:

yx.lm$coefficientsresiduals

Podemos observar directamente los residuos del modelo lineal haciendo el llamado residuals a partir de la variable que almacena la información del modelo lineal, para esto, recurrimos el símbolo de dólar $ usando la siguiente sintaxis:

yx.lm$residualsfitted.values

Podemos observar directamente los valores ajustados del modelo lineal, es decir, todos los valores estimados , haciendo el llamado fitted.values a partir de la variable que almacena la información del modelo lineal, para esto, recurrimos el símbolo de dólar $ usando la siguiente sintaxis:

yx.lm$fitted.valuesLa instrucción summary()

Si bien se puede obtener información individual haciendo un llamado a algunos elementos específicos del modelo lineal, una de las herramientas más valiosas que provee R para el análisis regresión lineal es el resumen del modelo pues a partir de él, podemos consultar los siguientes elementos:

Sobre el llamado

- Call – Nos indica la fórmula que define el modelo lineal.

Sobre los residuos

- Min – Mínimo.

- 1Q – Primer cuartil Q1.

- Median – Media (o segundo cuartil Q2)

- 3Q – Tercer cuartil Q3

- Max – Máximo.

Es importante verificar que el valor de la media de los residuos sea cero o esté muy cercano a cero, pues este es uno de los supuestos del Método de los Mínimos Cuadrado Ordinarios (MCO).

Sobre los coeficientes

- Estimate – Estimadores

.

- Std. Error – Error estándar de cada estimador.

- t value – Valor del estadístico

correspondiente a cada estimador.

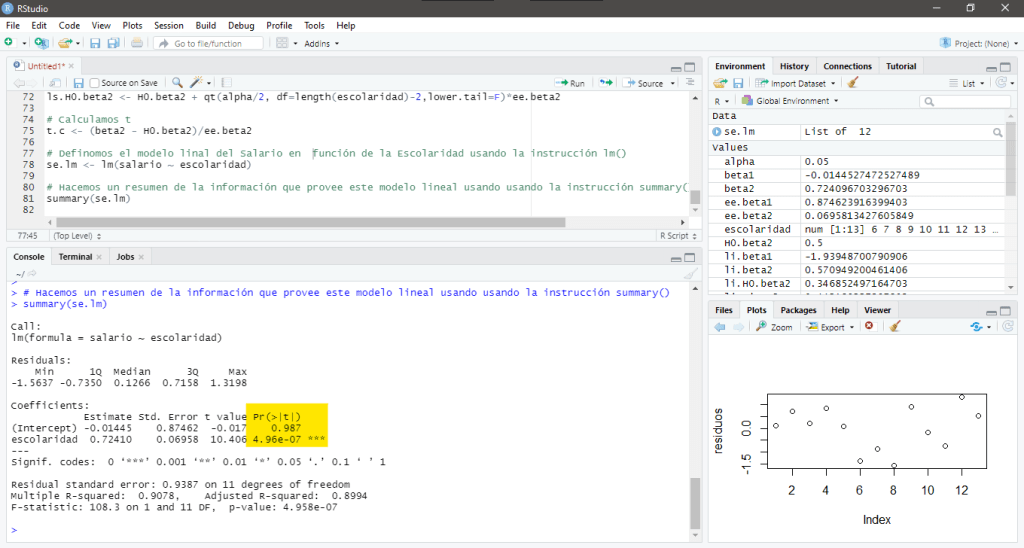

- Pr(>|t|) – p-value correspondiente la prueba t de cada estimador.

- Signif. codes – Códigos de significancia.

En este caso la prueba t plantea la hipótesis nula , por lo tanto, es importante verificar que el valor

sea lo más grande posible, pues esto nos indica la confianza con la que podemos rechazar la hipótesis nula.

El valor p o p-value determina la probabilidad exacta de cometer un error tipo I considerando el valor calculado, por lo tanto, es importante verificar que este valor sea lo más bajo posible, pues esto nos indica la confianza con la que podemos rechazar la hipótesis nula.

Para facilitar la interpretación del p-value, se utiliza un código de significancia, notando que

- 0 ‘***’ La probabilidad de cometer un error tipo I es prácticamente nula.

- 0.001 ‘**’ La probabilidad de cometer un error tipo I es de a lo sumo el 0.1%.

- 0.01 ‘*’ La probabilidad de cometer un error tipo I es de a lo sumo el 1%.

- 0.05 ‘.’ La probabilidad de cometer un error tipo I es de a lo sumo el 5%.

- 0.1 ‘ ’ La probabilidad de cometer un error tipo I es de a lo sumo el 1%.

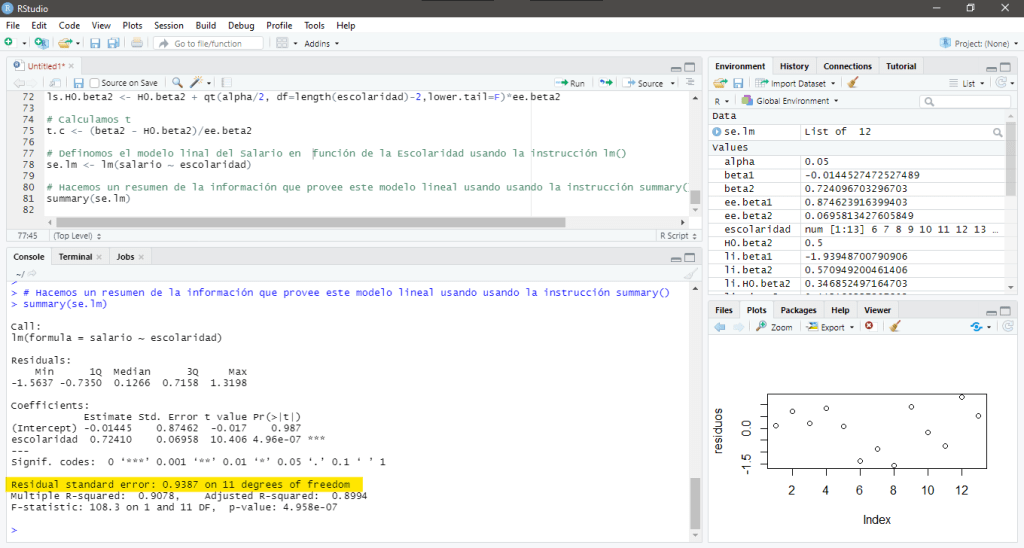

Sobre el error estándar de los residuos

- Residual standard error – Error estándar de estimación o error estándar de la regresión.

Recordando que el error estándar de estimación nos sirve como una medida de bondad de ajuste, es importante verificar que este sea lo más pequeño posible, recordando siempre que este nunca es igual a cero, pues se define a partir de una suma de cuadrados.

Sobre el coeficiente de determinación

- Multiple R-squared – Coeficiente de Determinación (sin ajuste al añadir más variables)

- Adjusted R-squared – Coeficiente de Determinación (con ajuste al añadir más variables)

Es importante añadir que al definir modelos, estos no necesariamente se determinan con dos variables, así que al incluir más variables el coeficiente de determinación que determina Multiple R-squared aumentará a medida que se agregan variables, por otra parte, el coeficiente de determinación que determina Adjusted R-squared será corregido por la cantidad de variables involucradas en el modelo por lo que indica de forma más realista en qué medida las variables independientes (en conjunto) explican a la variable dependiente.

Recordemos que si bien es importante que la variable independiente explique la variable pendiente, el objetivo del análisis de regresión no es que el valor del coeficiente de determinación sea igual a 1.

Sobre el estadístico F

- F-statistic – Estadístico F.

Para el caso de dos variables, la prueba F plantea la hipótesis nula , por lo tanto, es importante verificar que el valor

sea lo más grande posible, pues esto nos indica la confianza con la que podemos rechazar la hipótesis nula.

Para el caso de más variables, se plantea una hipótesis conjunta , y de igual forma, es importante verificar que el valor

sea lo más grande posible, pues esto nos indica la confianza con la que podemos rechazar la hipótesis nula.

El valor p o p-value determina la probabilidad exacta de cometer un error tipo I considerando el valor calculado, por lo tanto, es importante verificar que este valor sea lo más bajo posible, pues esto nos indica la confianza con la que podemos rechazar la hipótesis nula.

Ejemplo

Consideremos un pequeño conjunto de datos, particularmente, los datos que se encuentran en la Tabla 3.2 del libro de Econometría de Damodar N. Gujarati and Dawn Porter en su quinta edición. Este conjunto de datos proporciona los datos primarios que se necesitan para estimar el efecto cuantitativo de la escolaridad en los salarios:

| Observación | Salario | Escolaridad |

| 1 | 4.4567 | 6 |

| 2 | 5.77 | 7 |

| 3 | 5.9787 | 8 |

| 4 | 7.3317 | 9 |

| 5 | 7.3182 | 10 |

| 6 | 6.5844 | 11 |

| 7 | 7.8182 | 12 |

| 8 | 7.8351 | 13 |

| 9 | 11.0223 | 14 |

| 10 | 10.6738 | 15 |

| 11 | 10.8361 | 16 |

| 12 | 13.615 | 17 |

| 13 | 13.531 | 18 |

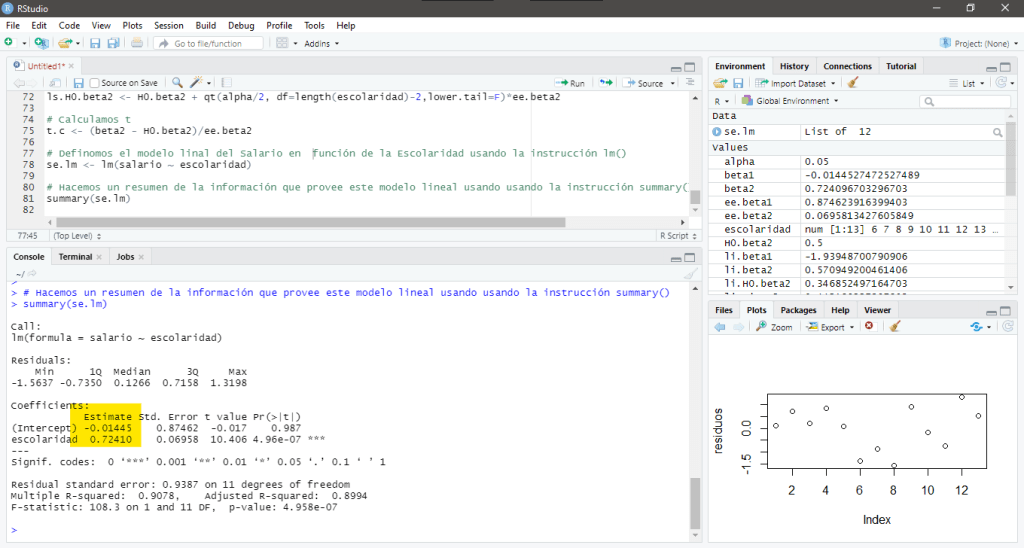

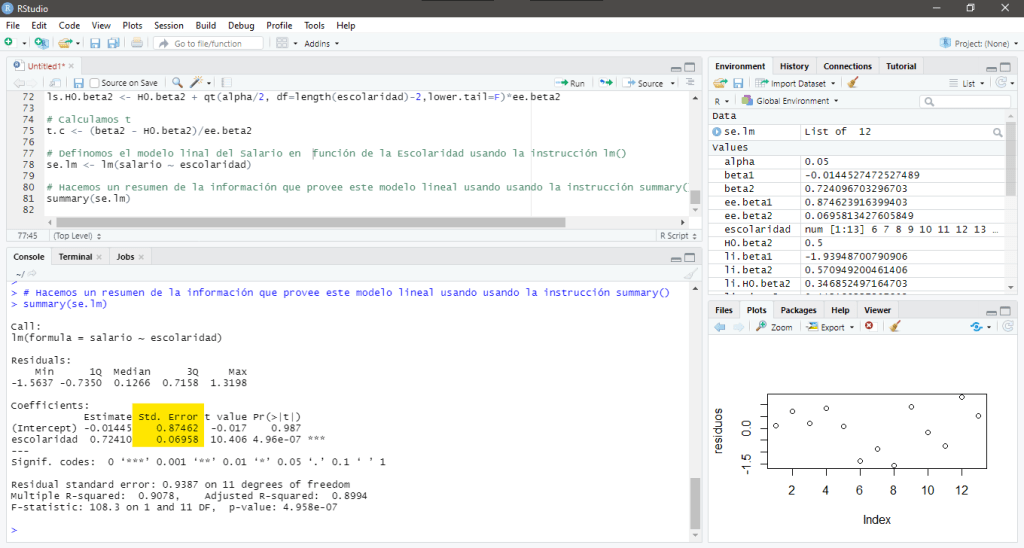

Definimos un modelo lineal que describe el salario en función de la escolaridad con la instrucción lm() y almacenamos esta información en la variable se.lm usando la siguiente sintaxis:

se.lm <- lm(salario ~ escolaridad)Posteriormente, hacemos un resumen de la información que provee este modelo lineal con la instrucción summary() usando la siguiente sintaxis:

summary(se.lm)Al ejecutar esta instrucción, inmediatamente aparecerá lo siguiente en la consola:

> summary(se.lm)

Call:

lm(formula = salario ~ escolaridad)

Residuals:

Min 1Q Median 3Q Max

-1.5637 -0.7350 0.1266 0.7158 1.3198

Coefficients:

Estimate Std. Error t value Pr(>|t|)

(Intercept) -0.01445 0.87462 -0.017 0.987

escolaridad 0.72410 0.06958 10.406 4.96e-07 ***

---

Signif. codes: 0 ‘***’ 0.001 ‘**’ 0.01 ‘*’ 0.05 ‘.’ 0.1 ‘ ’ 1

Residual standard error: 0.9387 on 11 degrees of freedom

Multiple R-squared: 0.9078, Adjusted R-squared: 0.8994

F-statistic: 108.3 on 1 and 11 DF, p-value: 4.958e-07

Usualmente el análisis de regresión se enfoca en el coeficiente que acompaña a la variable independiente y le resta importancia a los resultados expuestos sobre el intercepto. Dicho esto, podemos identificar los siguientes elementos en el resumen generado:

- La media de los residuos es igual a 0.1266, esto es un valor relativamente cercano a cero. Esto es algo que nos interesa pues es uno de los supuestos que debe cumplirse para que el Método de los Mínimos Cuadrados Ordinarios tenga validez.

- El valor del intercepto es

, esto quiere decir que una persona sin educación tiene un salario negativo y aunque esta situación carece se sentido, veremos en los demás resultados del resumen, que este valor tiene poca relevancia.

- El valor del coeficiente que acompaña a la variable

es

, esto quiere decir que cada año adicional de escolaridad, en promedio, produce aumentos en los salarios por hora de alrededor de 72 centavos de dólar.

- El modelo lineal está expresado de la siguiente forma:

- El error estándar correspondiente al nivel de estudios (escolaridad), indica que en promedio, las estimaciones variarán en 0.06958.

- El valor t para el estimador

es igual a -0.017, está muy cercano a cero, esto quiere decir que la hipótesis nula no se rechaza, es decir, el estimador

no es un elemento significativo en nuestro modelo.

- El valor t para el estimador

es igual a 10.406, está muy lejano de cero, por lo tanto la hipótesis nula se rechaza, y así, concluimos que el estimador

es un elemento bastante significativo en nuestro modelo.

- El p-value para el estimador

es igual a 0.987, está muy cercano a uno, esto quiere decir que la hipótesis nula no se rechaza, es decir, el estimador

no es un elemento significativo en nuestro modelo.

- El p-value para el estimador

es prácticamente cero, por lo tanto la hipótesis nula se rechaza, y así, concluimos que el estimador

es un elemento bastante significativo en nuestro modelo.

- El error estándar de los residuos es 0.9387, esto quiere decir que cualquier estimación que hagamos variará en 0.9387 centavos de dólar. Proporcionablemente, si comparamos esto con el promedio inicial -0.01445, tenemos que nuestra predicción se desviará en un 65.1875%.

- El coeficiente de determinación múltiple es igual a 0.9078 y el coeficiente de determinación ajustado es igual a 0.8994, recordemos que este último es corregido por la cantidad de variables y por eso es menor. En ambos casos, es relativamente alto, por lo que podemos concluir que los salarios están explicados en alrededor del 90% por el nivel de escolaridad.

- El valor F es igual a 108.3, es decir, está muy lejano de uno, por lo tanto la hipótesis nula se rechaza, y así, concluimos que el estimador

es un elemento bastante significativo en nuestro modelo.

- El p-value para el estimador

prácticamente cero, por lo tanto la hipótesis nula se rechaza, y así, concluimos que el estimador

es un elemento bastante significativo en nuestro modelo.

Bibliografía

- Quick Guide: Interpreting Simple Linear Model Output in R. (2021). Feliperego.github.io. Retrieved 31 May 2021, from https://feliperego.github.io/blog/2015/10/23/Interpreting-Model-Output-In-R

- lm function – RDocumentation. (2021). Rdocumentation.org. Retrieved 31 May 2021, from https://www.rdocumentation.org/packages/stats/versions/3.6.2/topics/lm

- Conor Neilson (https://stats.stackexchange.com/users/130345/conor-neilson), What is the main difference between Multiple R squared and Adjusted R squared?, URL (version: 2016-10-20): https://stats.stackexchange.com/q/241298

Debe estar conectado para enviar un comentario.